Agentic Flows vs LLM Flows: Cómo Elegir la Arquitectura Correcta para tu Sistema de IA

Agentic Flows vs LLM Flows: Cómo Elegir la Arquitectura Correcta para tu Sistema de IA

El Error que Cometen la Mayoría de las Empresas

Cuando una empresa decide implementar IA, casi siempre hace la misma pregunta: "¿Cómo usamos ChatGPT para automatizar esto?" Pero esa pregunta tiene un problema de base: asume que la solución siempre es un agente conversacional sofisticado.

La realidad es que existe un espectro completo de arquitecturas de IA, y elegir la incorrecta puede costarte tiempo, dinero y frustración.

Nota importante: Tanto OpenAI como Anthropic han publicado guías explícitas advirtiendo que "no siempre necesitas agentes". Para muchos casos de uso, las arquitecturas más simples son más confiables, más rápidas y más baratas.

El Espectro Completo de Arquitecturas de IA

Nivel 1: LLM Call (La Llamada Simple)

La forma más básica. Envías un prompt, recibes una respuesta. No hay herramientas externas, no hay memoria entre llamadas, no hay flujo de múltiples pasos.

Características:- Velocidad: Muy rápido (< 2 segundos)

- Costo: Muy bajo

- Predecibilidad: Máxima

- Complejidad de implementación: Mínima

Nivel 2: LLM Chain

Una secuencia predefinida de llamadas al LLM donde el output de una es el input de la siguiente. El flujo es determinista: el desarrollador controla exactamente qué pasa en cada paso.

Características:- Velocidad: Moderada (2-10 segundos)

- Costo: Bajo

- Predecibilidad: Alta

Nivel 3: LLM Workflow (Flujo con Herramientas Predefinidas)

Integra herramientas externas en un pipeline donde el LLM decide cómo usar herramientas, pero el desarrollador decide cuáles están disponibles en cada paso.

Características:- Velocidad: Moderada-Lenta (5-30 segundos)

- Costo: Moderado

- Predecibilidad: Media-Alta

Nivel 4: Agentic Flow (Agente con Autonomía Real)

El agente percibe el entorno, razona sobre el problema, selecciona dinámicamente qué herramientas usar, ejecuta acciones, observa resultados y decide el siguiente paso. Sin guía paso a paso del desarrollador.

Características:- Velocidad: Lenta (30 segundos a varios minutos)

- Costo: Alto — múltiples llamadas al modelo

- Predecibilidad: Baja-Media

La Tabla de Decisión

| Criterio | LLM Call | LLM Chain | LLM Workflow | Agentic Flow |

|---|---|---|---|---|

| El flujo es conocido de antemano | ✅ | ✅ | ✅ | ❌ |

| Necesita herramientas externas | ❌ | ❌ | ✅ | ✅ |

| El agente elige qué herramientas usar | ❌ | ❌ | ❌ | ✅ |

| Requiere razonamiento multi-paso abierto | ❌ | Parcial | Parcial | ✅ |

| Alta predecibilidad es crítica | ✅ | ✅ | ✅ | ❌ |

| Velocidad es prioridad | ✅ | ✅ | Parcial | ❌ |

| Costo operativo bajo es restricción | ✅ | ✅ | Parcial | ❌ |

La Arquitectura Ganadora de 2026: El Enfoque Híbrido

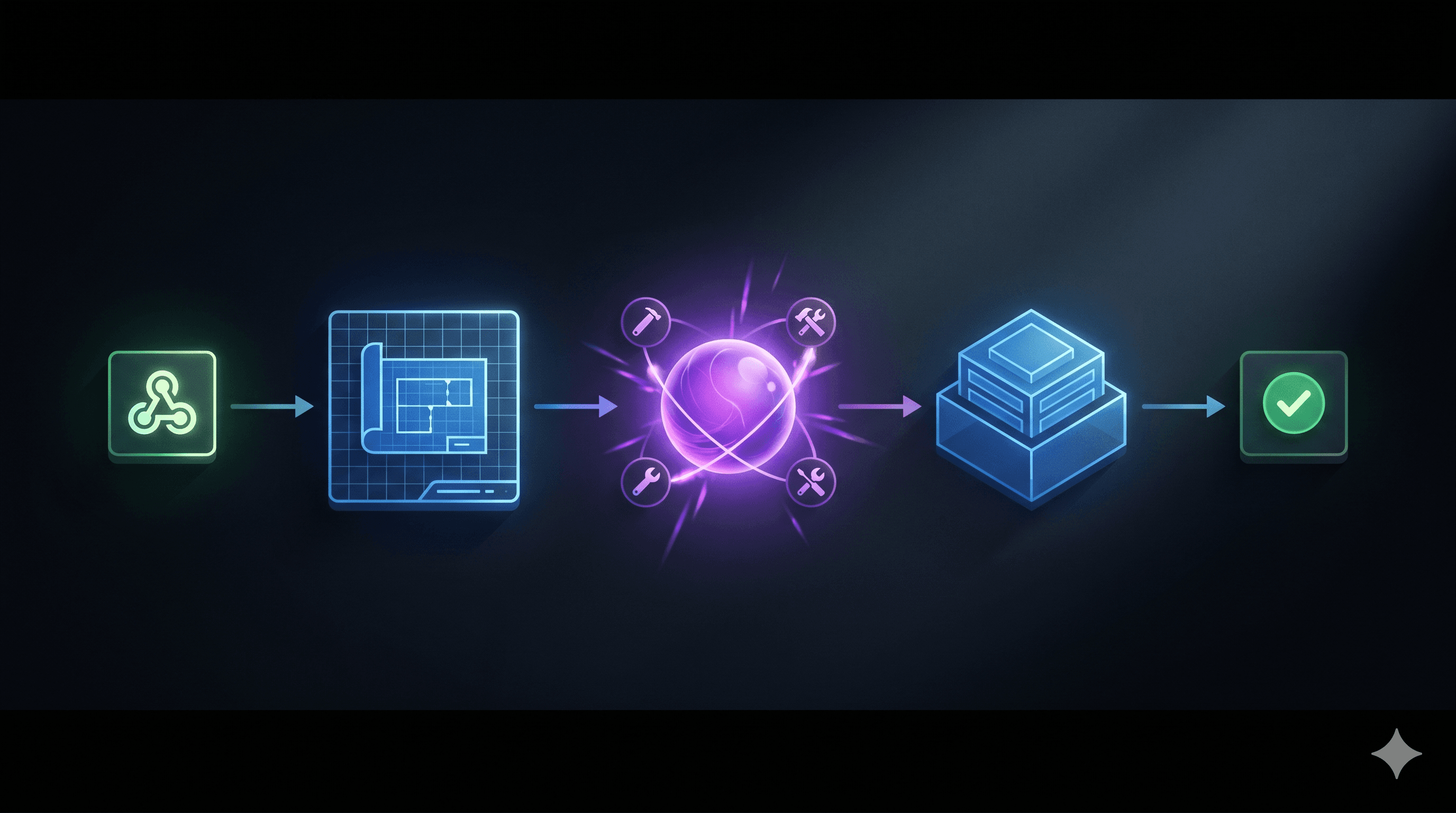

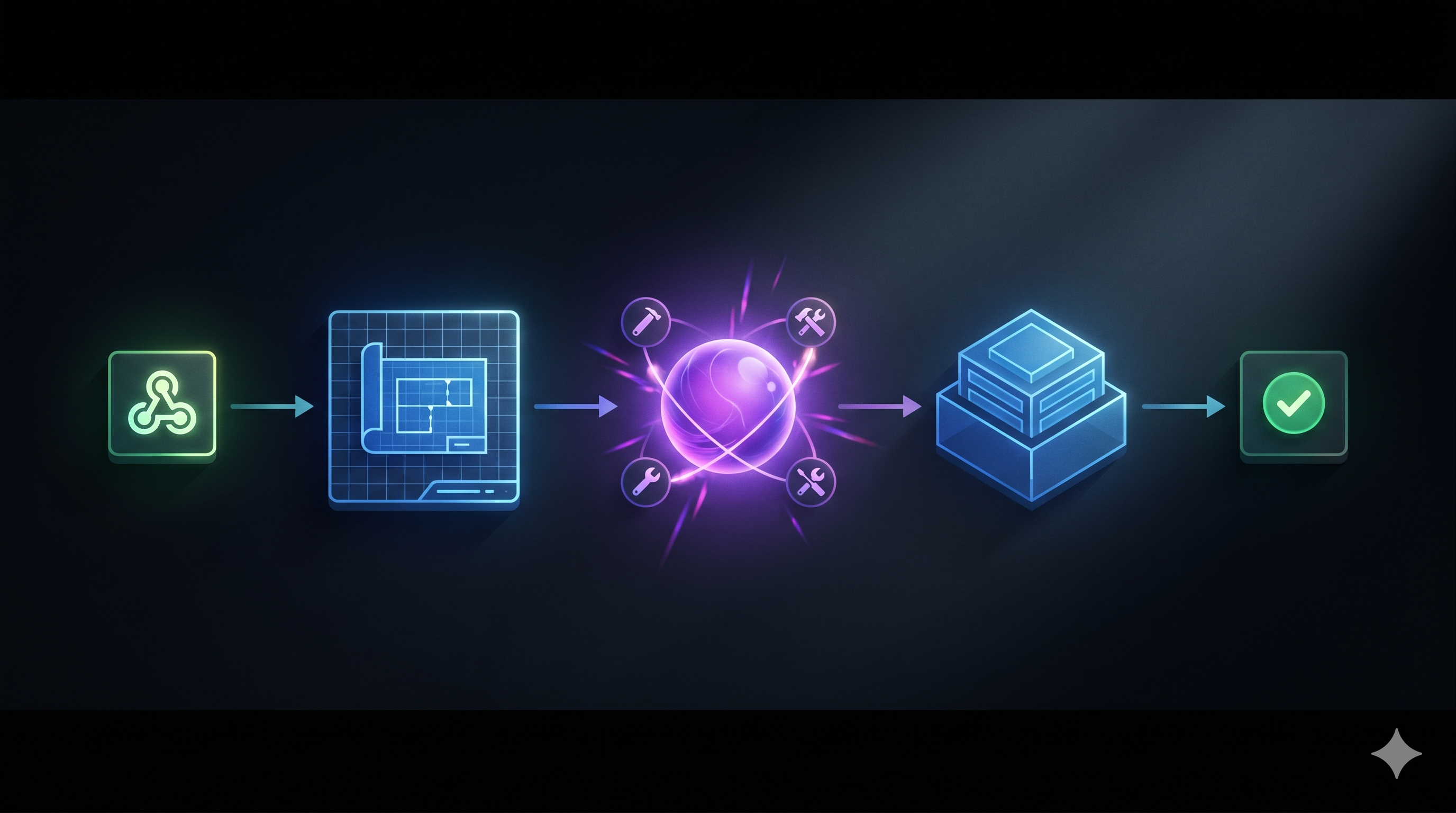

El consenso de la industria en 2026 es claro: no uses una sola arquitectura para todo. La estrategia ganadora —como muestra la ilustración— combina un backbone determinista con inteligencia agéntica desplegada estratégicamente donde el razonamiento dinámico agrega valor real:

[Trigger externo]

↓

[Workflow determinista: validar, clasificar, enrutar]

↓

[Nodo agéntico: investigar, razonar, decidir]

↓

[Workflow determinista: formatear, guardar, notificar]

↓

[Resultado entregado ✓]

Esta arquitectura tiene tres ventajas críticas:

- Predecibilidad donde importa: Los pasos de ingesta y output son deterministas. Sabes exactamente qué datos entran y en qué formato salen.

- Flexibilidad donde se necesita: El nodo agéntico maneja la complejidad sin que el desarrollador anticipe cada escenario.

- Control de costos: Solo pagas el costo computacional del agente en los nodos que realmente lo requieren.

Frameworks por Nivel de Arquitectura

Para LLM Calls y Chains simples: Anthropic SDK / OpenAI SDK directamente, sin overhead de frameworks. Para LLM Workflows: LangGraph (el más adoptado en enterprise — 34% de arquitecturas en empresas grandes), Temporal + LLMs para workflows de larga duración. Para Agentic Flows: OpenAI Agents SDK (estándar para modelos OpenAI, con handoffs y guardrails nativos), LangGraph (excelente con human-in-the-loop y time-travel debugging), CrewAI (menor curva de aprendizaje, ideal para prototipado rápido multi-agente).El Rol de MCP en la Arquitectura Híbrida

El Model Context Protocol (MCP) se ha convertido en el estándar de facto para conectar agentes y workflows con herramientas externas. Con 97 millones de descargas mensuales y 10,000 servidores disponibles (Salesforce, HubSpot, Slack, Notion, GitHub, PostgreSQL, Stripe y más), MCP elimina la necesidad de escribir código de integración personalizado.

En una arquitectura híbrida moderna, MCP actúa como el pegamento que conecta todos los niveles: los workflows consumen herramientas MCP para acciones predefinidas, y los agentes usan MCP para seleccionar dinámicamente qué herramientas necesitan en cada momento.

La Regla de Oro

Empieza siempre con la arquitectura más simple que resuelva el problema. Añade complejidad solo cuando sea estrictamente necesario.Un LLM Workflow bien diseñado que funciona en producción siempre es mejor que un Agentic Flow sofisticado que falla de maneras impredecibles. La madurez en IA no es usar la tecnología más avanzada —es saber cuándo cada herramienta es la correcta.

¿Quieres diseñar la arquitectura de IA correcta para tu caso de uso? En Agentik ayudamos a empresas mexicanas a identificar el nivel óptimo de automatización e implementarlo en producción.